Llegó el festival anual psicodélico de la criticalidad en la física y en áreas afines. Tenemos entradas para ver ejemplos de fenómenos críticos en física de materiales, sistemas biológicos, fluidos, cosmología, y hasta en neurociencias. Los links de bandas que tocaron en un festival de nombre similar llevan a videos en YouTube. ¡Y para escuchar más música está la playlist oficial de la materia! Y ahora sí, criticalidad y autosemejanza:

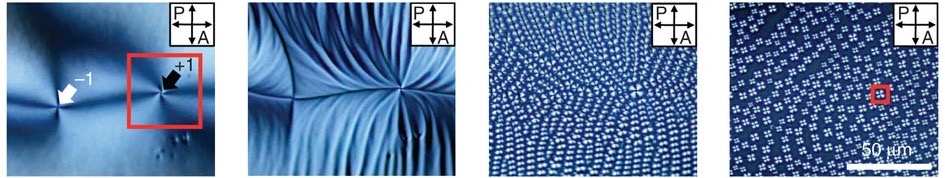

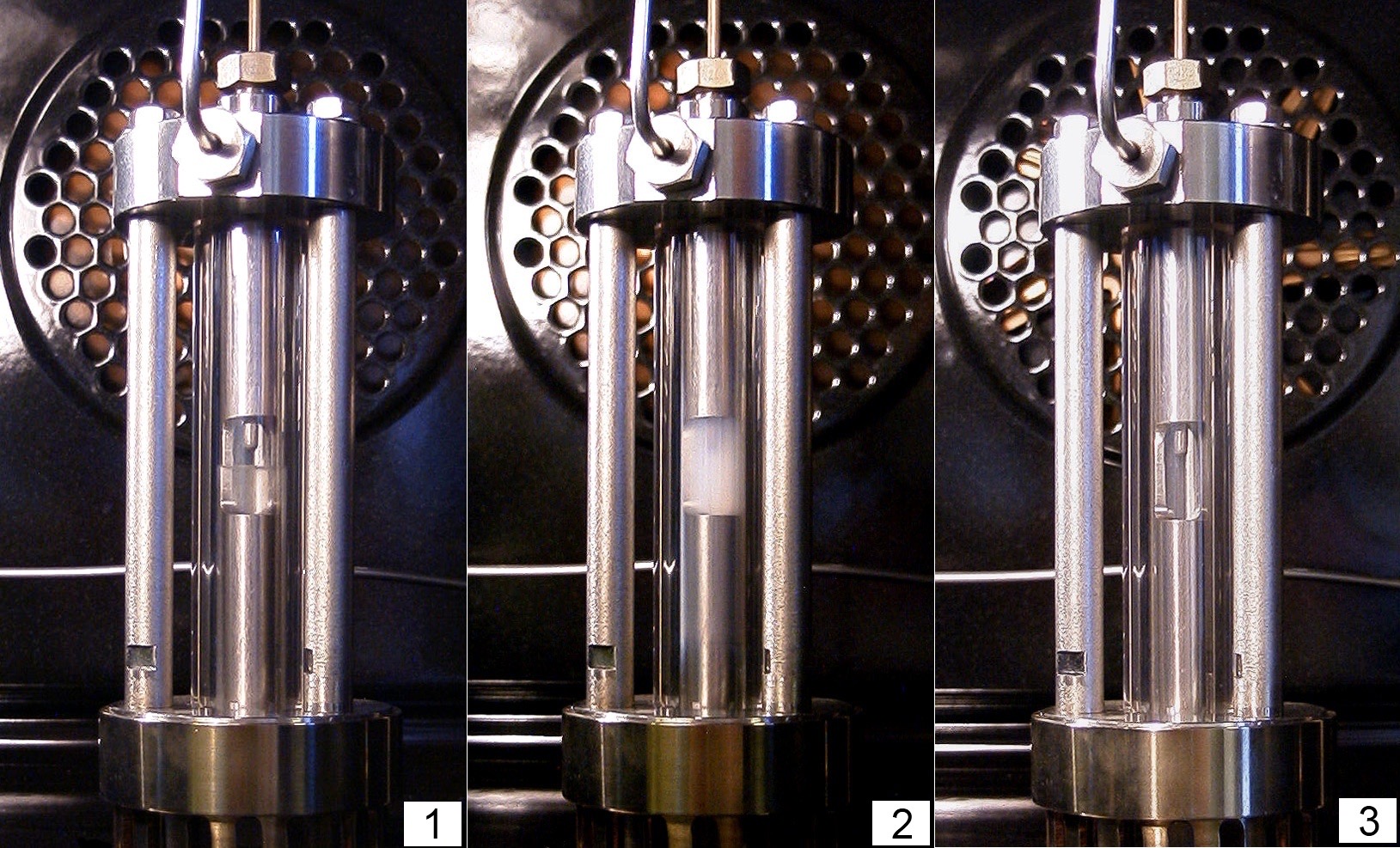

Comencemos con el lineup. En el escenario principal, después de Guns N’ Roses, tenemos dos ejemplos de física de materiales y materia condensada. Ya conocemos las transiciones de fase asociadas a los cambios de estado de la materia (sólido, líquido y gaseoso). ¡Pero existen muchos más cambios de fase! Así que veamos el show de bandas menos conocidas (y con ejemplos recientes de publicaciones en física). Primero tenemos a los cristales líquidos. Los cristales líquidos están formados por moleculas anisótropas (generalmente alargadas, por ejemplo con forma de largos cilindros), por lo que se comportan con propiedades intermedias entre los líquidos y los sólidos de acuerdo a en que dirección del material se aplican los esfuerzos. Y tienen al menos dos fases: en la fase nemática (a mayor temperatura) las moléculas están más desordenadas, pero se alinean a lo largo de sus ejes principales. En cambio, en la fase esméctica (a menor temperatura) las moléculas se acomodan en capas más ordenadas, y dentro de cada capa las moléculas están inclinadas con el mismo ángulo. El cambio entre ambas fases es una transición de fase con propiedades críticas. Los interesados pueden mirar un paper reciente (Gim, Beller & Yoon, Nat. Commun. 8, 15453, 2017), donde encontrarán esta figura alucinante con cambios morfológicos del material durante la transición (para temperatura creciente, de izquierda a derecha):

También pueden mirar este paper (el preprint de acceso libre está disponible acá) en el que los autores demuestran la existencia de una fase nemática en un modelo de cristales líquidos formados por barras en una red bidimensional. Y los que quieran leer otro ejemplo de transiciones de fase en materiales, pueden mirar este artículo sobre transiciones sólido-sólido que ocurren por cambios en la forma de partículas coloidales.

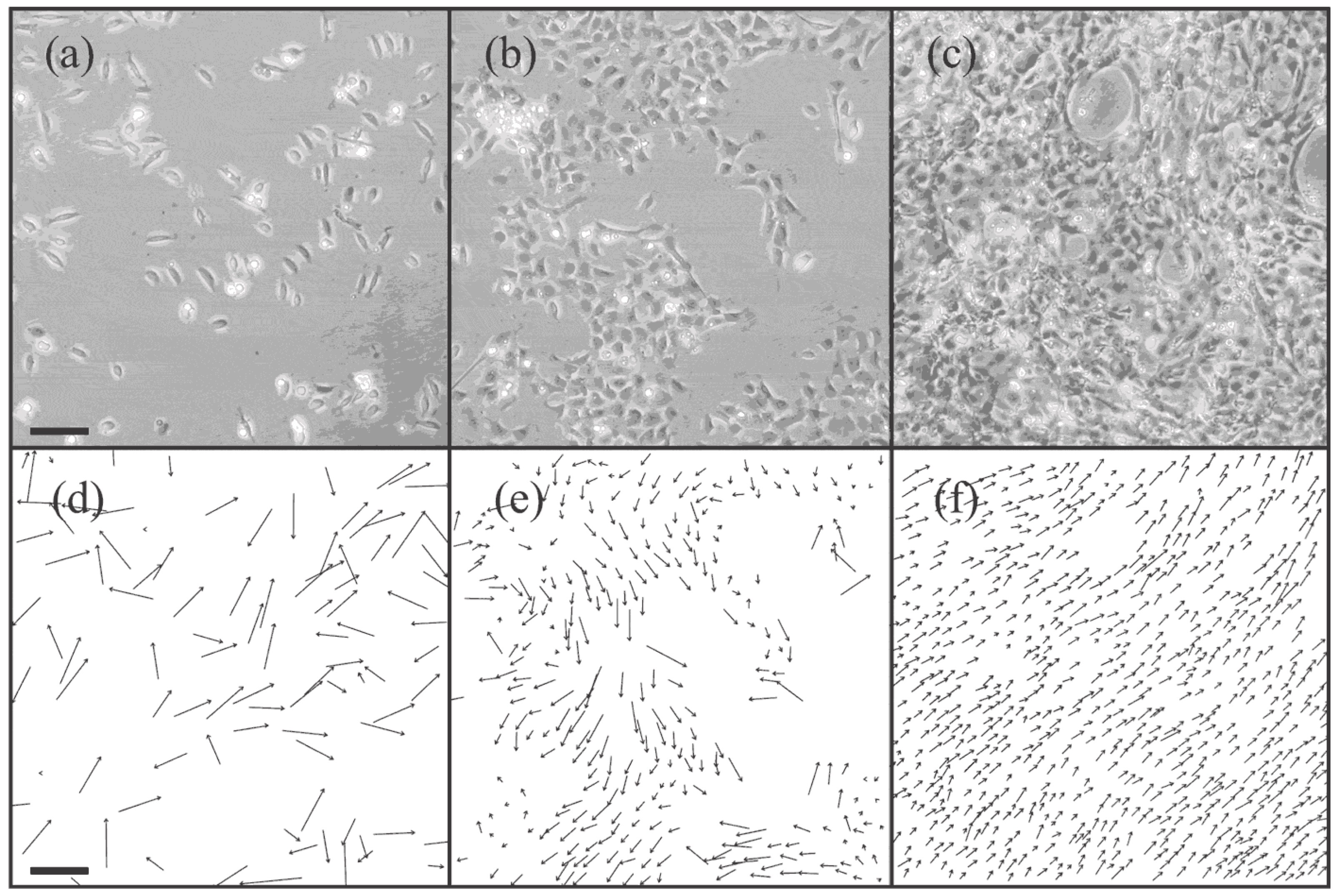

Vayamos a otro escenario del Criticalpalooza, y mientras escuchamos The Flaming Lips, veamos ejemplos recientes de transiciones de fase y autosemejanza observados en sistemas biológicos. Ciertas células cambian sus patrones de movimiento de acuerdo a la densidad de células en su entorno. A baja densidad muestran un movimiento desordenado, mientras que a alta densidad muestran patrones de movimiento colectivo y ordenado. La transición entre ambos comportamientos ocurre como una transición de fase. Pueden ver un ejemplo en Szabó et al., Phys. Rev. E 74, 061908 (2006) (el preprint está diponible en este link). La siguiente figura, de ese paper, muestra los patrones de movilidad al aumental la densidad de las células (de izquierda a derecha). Noten el cambio en el orden del sistema:

Los que tengan interés por ver más aplicaciones en biofísica, pueden mirar también un paper sobre fenómenos críticos en membranas lípidas (¡donde estiman exponentes críticos!).

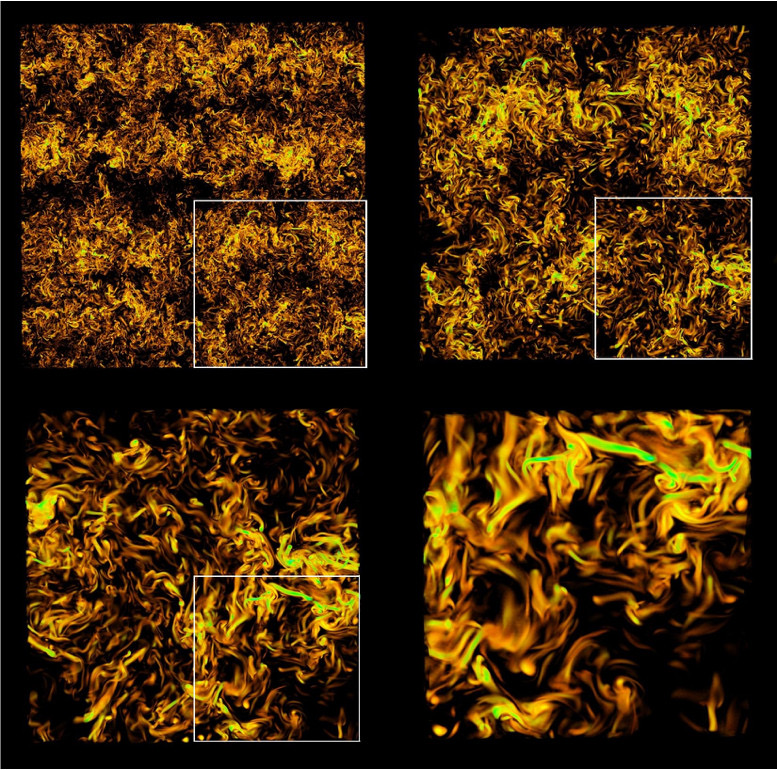

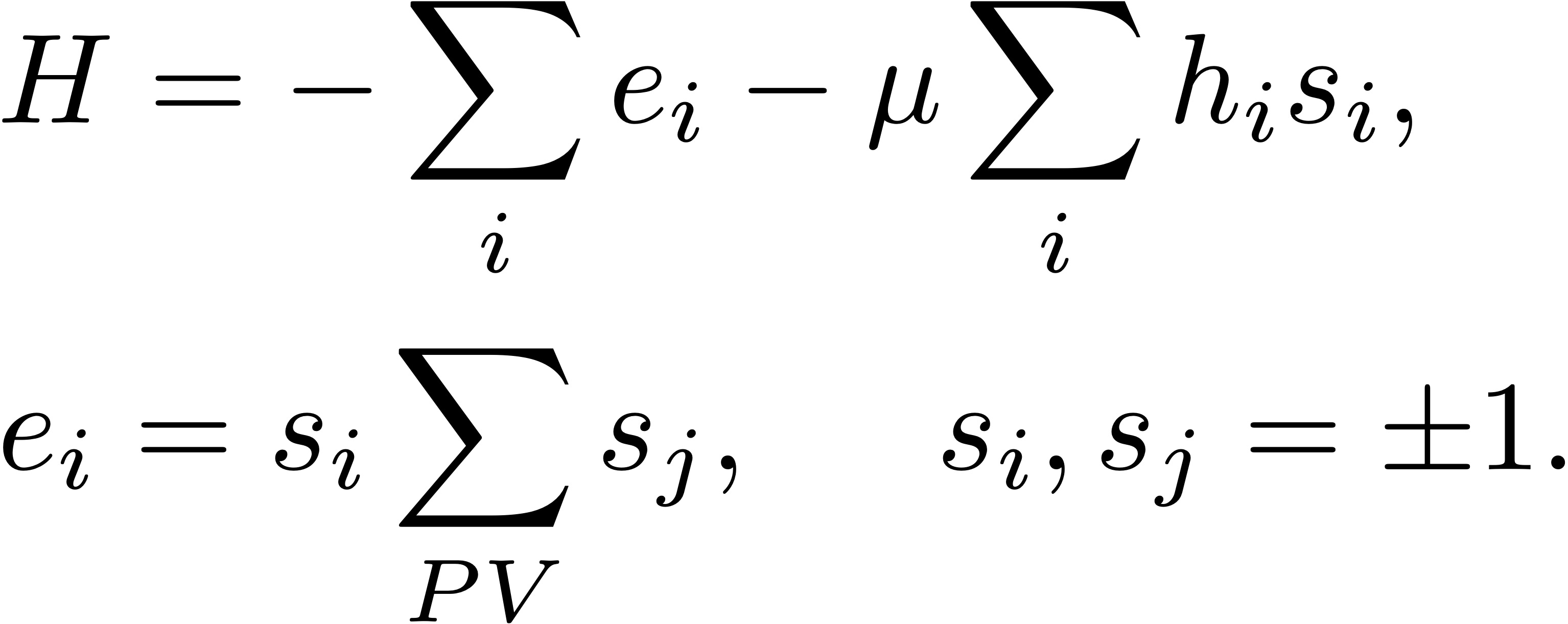

En el mismo escenario donde toca Metallica tenemos una variedad de fenómenos autosemejantes que se observan en fluidos. El más conocido es el fenómeno de la turbulencia, que es heavy metal. Los fluidos más viscosos (donde la viscosidad se mide con un número adimensional, el número de Reynolds) fluyen en forma ordenada y laminar. Pero al aumentar el número de Reynolds (y reducirse la importancia de la viscosidad), generan flujos muy desordenados que tienen propiedades de invariancia de escala. En la siguiente figura, noten como zooms sucesivos en el flujo parecen repetir los patrones (algo similar a lo que vimos en el modelo de Ising en 2D):

Esta es una transición extraña, porque los flujos turbulentos tienen propiedades de criticalidad y autosemejanza, pero son un sistema fuera del equilibrio. Pueden ver más imágenes de flujos turbulentos aquí. Y pueden ver un ejemplo de una transición de fase en turbulencia en un condensado de Bose-Einstein en este paper.

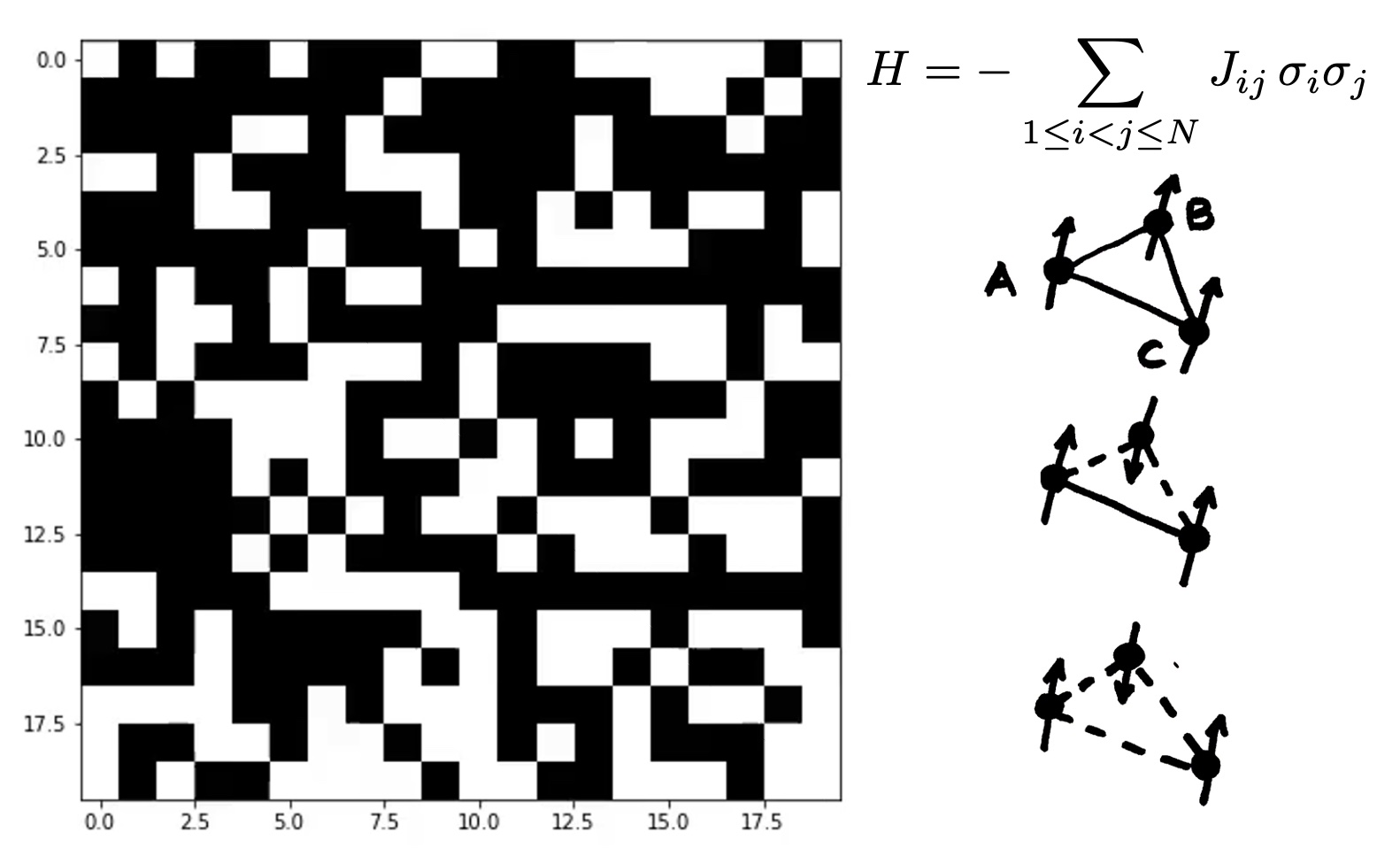

Los que tengan interés por cosmología pueden ir al escenario donde tocan Empire of the Sun y Lee Smolin, y leer este artículo donde se discuten diversos problemas (como la formación de galaxias espirales, la estructura de gran escala del universo, o el universo temprano) desde el punto de vista de fenómenos críticos. Bastante más difícil de leer, pero que sirve como ilustración, es este paper donde se estudia una transición de fase al compactificar una dimensión en teorías de gravedad (compactificar es “enrollar” una dimensión sobre si misma, y hacer tender ese “rollo” a cero). Y en cosmología, algunas teorías predicen que otra transición de fase podría haber ocurrido en el universo temprano, cuando se formaron los primeros átomos. Luego de ese momento el universo se volvió transparente, pero antes de ese instante el universo puede haber sido opalescente en forma crítica (como la mezcla de un líquido y un gas cuando llega a la temperatura crítica y dejan de existir las diferencias entre ambas fases, como se ve en la foto del centro en esta imágen de una mezcla de etano líquido y gaseoso tomada de Wikipedia):

Ya que estamos en el festival, no nos olvidemos de ir a ver las bandas clásicas. El mecanismo de Higgs por el cual los bosones de gauge adquieren masa, es también un mecanismo de ruptura espontánea de la simetría.

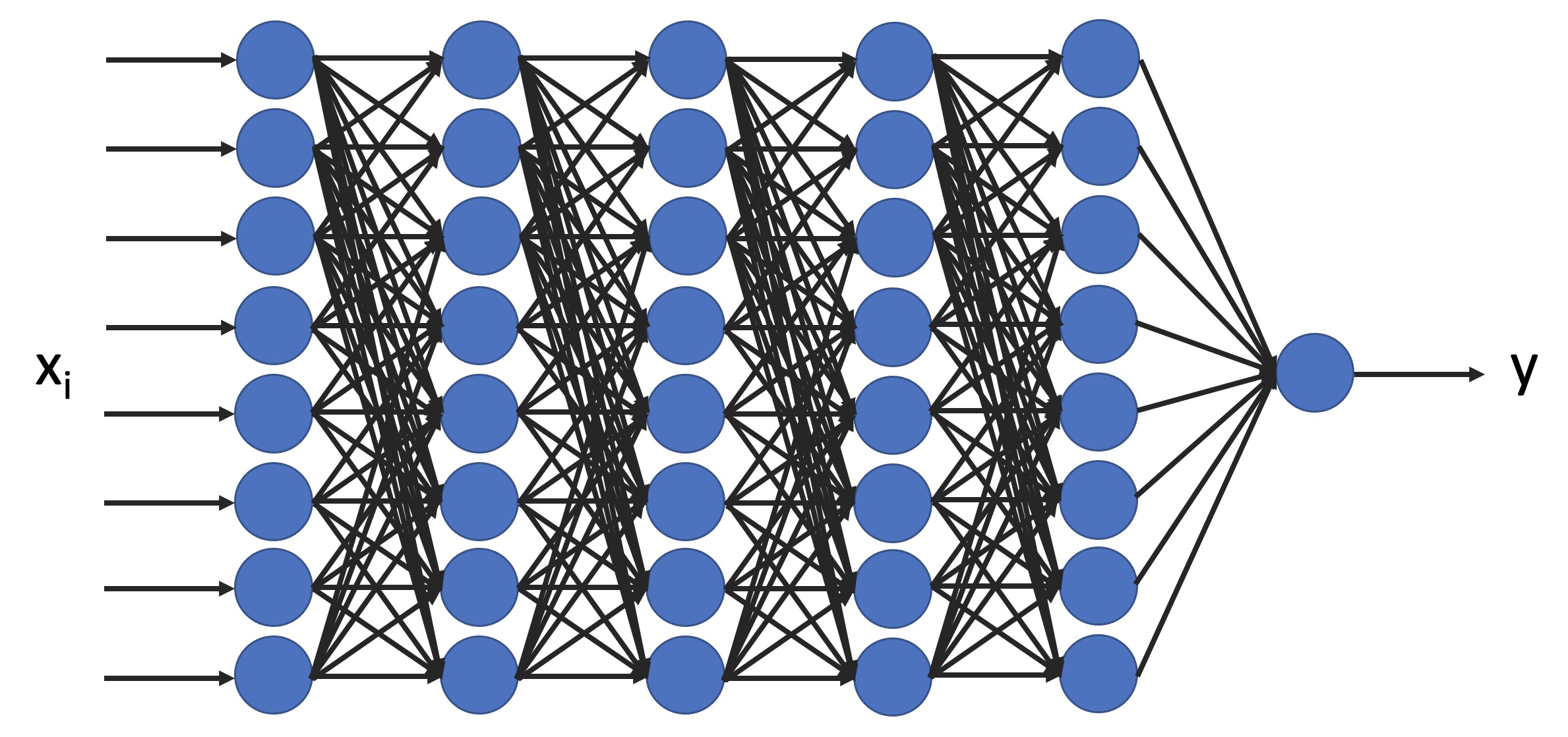

Para cerrar el festival, este Criticalpalooza no tendrá a The Strokes, pero tiene ejemplos de fenómenos críticos en el cerebro (¿lo entendieron?). Las funciones cognitivas involucran procesos que van desde las neuronas individuales hasta regiones grandes del cerebro, y en los últimos años se encontró evidencia creciente de que el cerebro funciona en el borde entre el orden y el desorden, con propiedades de fenómenos críticos. Los interesados en ver ejemplos de criticalidad y autosemejanza en el cerebro pueden mirar este paper o este paper. La siguiente imagen, tomada de Cochi et al., Progress in Neurobiology 158, 132 (2017) (el primero de los dos papers) es bastante sugerente: