A todos los que rindieron el primer parcial, ya les he enviado su parcial corregido con su nota. Deberían haber recibido dos mails míos esta tarde. Si alguno no los recibió, que avise!

Física macroscópica, Turing y Gödel

Hace unos años un grupo de científicos demostró que, para un problema particular, obtener ciertas propiedades macroscópicas a partir del conocimiento completo y preciso de las leyes microscópicas del sistema es indecidible. El problema particular que consideraron es el de calcular la diferencia de energía entre niveles de un semiconductor (el “gap espectral“, o la energía necesaria para mover un electrón del estado fundamental al estado excitado, en un sistema con muchos electrones). El valor del gap espectral tiene un impacto en el comportamiento macroscópico del sistema: los semiconductores tienen un gap espectral y sus propiedades físicas dependen de este gap, mientras que si no existe un gap, el material sufre una transición a otro estado.

Lo que se demostró es que conociendo completamente la física microscópica del sistema cuántico, la pregunta “¿tiene el sistema un gap espectral?” es indecidible. Que este problema sea indecidible significa que es imposible construir un algoritmo general que siempre nos de la respuesta correcta. Esto no significa que la pregunta no pueda contestarse, o que no pueda calcularse el valor del gap. Lo que significa es que el cálculo de esta propiedad macroscópica (aún conociendo completamente la física miscroscópica del sistema) no puede hacerse usando un único algoritmo que valga en todos los casos. En otras palabras, puede existir un algoritmo que permita obtener la respuesta para un material particular, pero que para otro material el mismo método no sirva. O, como dicen los autores del trabajo, “no puede existir un método general que permita determinar si un material descripto por la mecánica cuántica tiene un gap espectral o no”. No hay atajos elegantes. Hay que hacer física.

La demostración de indecibilidad se realizó mostrando que el problema es equivalente al problema de la parada de Turing. En 1936, Turing demostró que no es posible escribir un “programa” que ejecutado en una “computadora” (técnicamente, un algoritmo en una máquina de Turing) pueda decidir si otro algoritmo terminará de ejecutarse en un número finito de pasos o no. El teorema de Turing está relacionado con otros dos teoremas famosos de Gödel, que dicen (en su forma débil) que es imposible escribir en forma algorítmica un conjunto de reglas (o axiomas) para generar la aritmética que sea a la vez correcta y completa. Noten que si el sistema es incompleto, en algún momento encontraremos algún teorema válido que no podremos probar con los axiomas que tenemos. ¡Y si es incorrecto, en algún momento podremos probar que vale cierto teorema, y también que no vale ese mismo teorema!

Los que quieran saber más pueden leer un artículo sobre el problema del gap espectral en Phys.org, o el paper original publicado en la revista Nature:

Sin embargo, noten que este resultado no implica que no podamos obtener teorías físicas fundamentales, que no se pueda conocer el Hamiltoniano que describe la física básica del problema, o que no se pueda conocer si el sistema tiene un gap o no. Lo que implica es que no alcanza con saber matemáticas y usarlas como en una “receta”, y que siempre tendremos que hacer aproximaciones o consideraciones según la física de cada sistema.

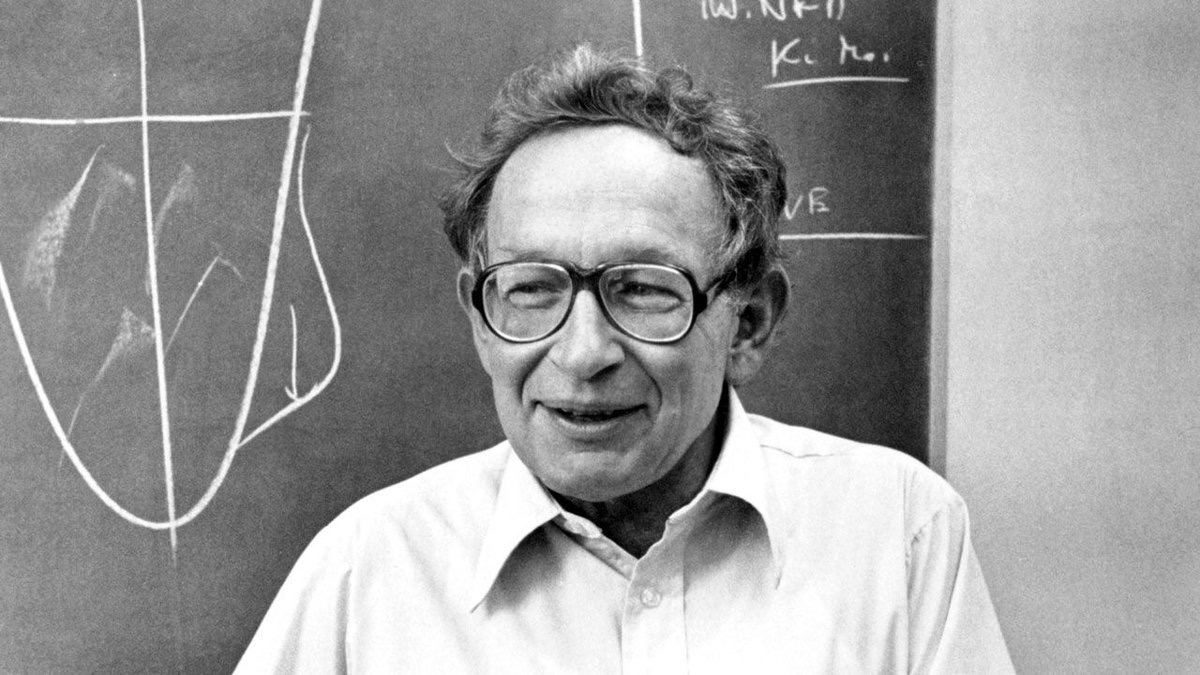

El resultado sobre la indecibilidad del problema del gap espectral es parte de varios resultados recientes que identifican problemas indecidibles o no computables en diferentes áreas de la física (tanto clásica como cuántica), y parten de una pregunta hecha en 1994 por Roger Penrose en un libro hermoso pero también polémico, en el que Penrose se pregunta si existirán problemas de este tipo en sistemas físicos. Mas allá de los detalles técnicos, los resultados pueden ser muy perturbadores para los que esperaban que el curso de mecánica estadística les permita justificar, en forma sistemática, todo lo que no comprendemos de la física macroscópica a partir de fenómenos microscópicos (¡que probablemente tampoco comprendamos muy bien!).

En cierto sentido, esto tiene una relación con la visión de las jerarquías en la física de Feynman de un posteo anterior, donde Feynman decía que es un error pensar que uno puede partir de uno de los extremos (la física microscópica) y caminar solamente desde ese extremo hacia el otro (la física macroscópica), creyendo que de esa forma se alcanzará un entendimiento completo. En esta línea de pensamiento les aconsejo fuertemente leer también este genial artículo de 1972 de Philip Anderson:

donde el señor Anderson entre otras cosas dice:

“The ability to reduce everything to simple fundamental laws does not imply the ability to start from those laws and reconstruct the universe [...] At each stage entirely new laws, concepts, and generalizations are necessary, requiring inspiration and creativity to just as great a degree as in the previous one.“

La intuición física de Feynman y de Anderson (y de muchos otros físicos) se adelantó a estos resultados más recientes y más formales. Vale aclarar que este artículo de Anderson a veces es mal interpretado. Anderson no dice que los sistemas extensos sigan nuevas leyes fundamentales, o que nuevas fuerzas fundamentales aparezcan como resultado de considerar sistemas con nuevas partículas. Pero sí dice que conocer las leyes fundamentales no es suficiente para con ellas reconstruir el universo en forma sistemática, y que al considerar cada aumento en la escala del sistema, es necesario realizar nueva investigación en física básica, e introducir nuevos conceptos, nuevas ideas y nuevas generalizaciones. Cada capa de la cebolla requiere aproximaciones nuevas, ideas ingeniosas, y mucha creatividad.

¿Y por qué el Señor Anderson insiste con esto? ¿Por qué lo hace? Porque elige hacerlo:

¡Y no dejen de ver el posteo previo, con un notebook que armó uno de sus compañeros para los problemas de la guía 2!

Simulaciones de la guía 2

Para los que se coparon con la guía 2, ahí va un notebook de Python que hizo el alumno Tomás Di Napoli, donde simula varios de los experimentos involucrados en los problemas de esa guía y compara con las soluciones analíticas. Gracias Tomás por compartirlo!

El transportador

¡Fin de semana a pura acción! Luego del parcial, y para cerrar los temas de primera mitad de la materia, hablemos de fenómenos de transporte. En clase vimos como el límite macroscópico de la ecuación de Boltzmann nos da las ecuaciones de los fluidos para un gas muy diluido, y cómo el retorno al equilibrio del sistema puede caracterizarse, macroscópicamente, con coeficientes de transporte (¿qué equilibrio estaría intentando restablecer Frank Martin en sus tres películas?).

La validez del límite hidrodinámico puede verse también en simulaciones numéricas, y a veces la ecuación de Boltzmann o ecuaciones de dinámica molecular para un número muy grande de partículas se usan para simular la dinámica macroscópica de gases y líquidos. En clase vimos un ejemplo de difusión usando Colab con apenas 400 partículas, pero con tiempo y paciencia pueden hacerse cosas más grandes. Tomemos el caso de una instabilidad macroscópica que ocurre en gases y líquidos cuando existe un gradiente tangencial en el momento del fluido: la intestabilidad de Kelvin-Helmholtz.

La inestabilidad de Kelvin-Helmholtz ocurre cuando dos fluidos (usualmente con densidad diferente) se mueven en dirección contraria. En la superficie que separa los dos fluidos el gradiente de velocidad es muy grande. Esta superficie es inestable frente a pequeñas perturbaciones, y al intestabilizarse se genera un patrón de vórtices conocidos como vórtices de Kármán. La intestabilidad que se desarrolla intenta recobrar una distribución homogénea del momento, y resulta en un mezclado y transporte eficiente entre las dos regiones del fluido. Pueden ver un ejemplo de macroscópico en la siguiente foto de unas nubes, noten “las crestas” en el borde superior de las nubes, que resultan en el transporte y mezclado del gas en la parte mas baja con el gas en la parte superior.

Esta misma inestabilidad puede verse en una simulación de dinámica molecular de la mezcla de dos gases usando 9.000.000.000 de partículas (¡comparen este número con las 400 que usamos en clase en el Colab!). Observen cómo se forman las mismas estructuras que en la foto, cómo la mezcla se vuelve cada vez más homogénea como resultado de las colisiones y el transporte, y cómo un flujo macroscópico emerge de la dinámica molecular microscópica:

Para la mayoría de las aplicaciones no podemos (ni tiene mucho sentido) realizar simulaciones con 9.000.000.000 de partículas. En la práctica, la mezca entre dos gases con diferente densidad, la difusión de cambios en la temperatura de un gas, o la conducción de electricidad por el movimiento de los portadores de carga en un conductor, se describen con coeficientes macroscópicos en ecuaciones en el límite hidrodinámico: los coeficientes de transporte. La viscosidad, la conductividad térmica, y la conductividad eléctrica son ejemplos de este tipo de coeficientes. Desde un punto de vista termodinámico, los coeficientes de transporte y su rol en termodinámica de sistemas fuera del equilibrio pueden estudiarse con las relaciones recíprocas de Onsager. En particular, estas relaciones permiten definir coeficientes de transporte en forma precisa, como la razón entre el flujo medio de una cantidad transportada (que intenta recobrar el equilibrio) y el gradiente macroscópico que genera el desbalance en el sistema. Así, los coeficientes de transporte en general toman la forma

donde κ es el coeficiente de transporte, Ju es el flujo medio de alguna magnitud transportada microscópicamente por los choques de moléculas en el gas, y ∇θ es el gradiente de alguna magnitud macroscópica. Por ejemplo, cuando generamos una diferencia en la temperatura entre dos puntos de un gas, se establece un flujo de energía cinética térmica que intenta recobrar la temperatura homogénea, y el coeficiente que mide ese transporte (la razón de proporcionalidad entre ambas magnitudes) es la conductividad térmica. O, si generamos una diferencia de potencial electrostático, se establece una corriente (un flujo de carga), y el coeficiente de proporcionalidad es la conductividad eléctrica.

El primer parcial y su resolución

Arrancó el primer parcial

Recién mandé mail a cada uno de ustedes con el primer parcial. Si alguno no lo recibió, que avise! Los docentes de la práctica estaremos conectados al aula zoom durante todo el parcial. Suerte a todos!

Indicaciones sobre el parcial

Posteo por acá un mail que mandé a todos el jueves pasado con indicaciones sobre el parcial, por si alguno no lo recibió.

Horario: miércoles 12 de mayo, de 17 a 22hs. A las 17hs van a recibir un mail mío con el parcial. Las 22hs es la hora límite para entregar: parciales entregados después de esa hora se considerarán no entregados.

Formato de entrega: tienen que mandarme un único pdf con su resolución a mí, guillem@df.uba.ar. El nombre del archivo debería ser Apellido_Nombre.pdf (por ejemplo, el alumno Juan Pérez enviará el archivo Perez_Juan.pdf). Si alguno quiere hacerlo en latex genial, pero no es para nada obligatorio: pueden hacerlo a mano, sacar foto y convertir a pdf. Sobre esto último, dos comentarios:

1) Asegúrense en estos días de que dominan la técnica para convertir su parcial en un pdf, para que eso no les haga perder tiempo el día del parcial.

2) Asegúrense también de que el pdf que producen se puede leer claramente (eso también tiene que ver con su prolijidad al escribir). Tengan en cuenta que lo que no se entienda no se podrá evaluar.

Qué se puede hacer y qué no: el parcial es a libro abierto, pueden consultar las referencias que quieran. También, si quieren apoyarse en Wolfram para hacer alguna cuenta pueden hacerlo. Lo que no pueden hacer, obviamente, es cooperar entre ustedes (copiarse). A estas alturas, confiamos en que tienen el sentido ético, la dignidad y el respeto (hacia los demás y hacia ustedes mismos) para que eso ni siquiera se les pase por la cabeza. En caso de que detectemos algo raro en alguna resolución, nos reservamos el derecho de tener una entrevista por skype/zoom/meet con el alumno para asegurarnos de que su resolución fue legítima.

Consultas durante el parcial: sólo se permiten consultas de enunciado. Cualquier otro tipo de consulta no será respondido. Las consultas se formularán y responderán únicamente a través del aula zoom, a la que los docentes estaremos conectados durante el parcial. Se recomienda que todos los alumnos se conecten también, para formular sus consultas y para escuchar las consultas de otros. Pero esto no es obligatorio y no es una forma de control: no hace falta que tengan el micro abierto ni la cámara prendida.

Evaluación: todos los problemas del parcial valen lo mismo, y se aprueba con un 6.

Recomendación: las guías más importantes de esta primera parte de la cursada son la 3 y la 4.

Mucha suerte a todos!

Full Metal Thermodynamics

Full Metal Jacket (1987) es una película de Stanley Kubrick sobre la guerra de Vietnam. La película es famosa por mostrar, con un humor bastante peculiar, el maltrato físico y verbal de un grupo de cadetes por parte del sargento de artillería Hartman. Ronald Lee Ermey, un ex-instructor de la marina y que Kubrick había contratado como asesor técnico, audicionó y se quedó con el papel de Hartman. Muchas de las escenas en las que el sargento insulta a los cadetes, hablando rápido y a los gritos, fueron improvisadas o basadas en las experiencias previas de Lee Ermey como instructor en la marina. Se estima que cerca de la mitad de sus diálogos no estaban en el guión original, y fueron inventados a medida que se filmaba.

Hay armaduras de acero (pero tengan en cuenta que “Full Metal Jacket” se refiere a un tipo de munición, y no a un chaleco), alquimistas de acero, y se puede hacer termodinámica con bolas de acero. En teoría cinética de los gases definimos el tensor de presión de un gas a partir del tensor de flujo de momento asociado a las fluctuaciones térmicas. El siguiente video ilustra como se relaciona la presión con el momento entregado por los choques de partículas contra las paredes de un recipiente. Y lo hace en forma muy visual, usando bolas de acero (bastante grandes) que se sacuden al azar dentro de un tubo:

Pueden hacer el experimento equivalente (numérico en lugar de en el laboratorio) con el notebook con el modelo del gas ideal de esferas rígidas. Cada vez que una esfera rígida choca contra una pared, la componente normal de la velocidad cambia de signo. Por ejemplo, cuando una partícula con velocidad vx choca contra una pared con normal x, su velocidad cambia a -vx. Y como resultado, el cambio total en el momento lineal de la partícula (en valor absoluto) es -2mvx. Luego, la pared absorve un momento igual a 2mvx.

Usando esto, y contando la cantidad de choques contra una pared, se puede calcular la fuerza que las partículas ejercen sobre la pared como resultado de los choques.

Los que no hayan visto Full Metal Jacket, ya tienen mi recomendación de película para ver el fin de semana. Pueden aprovechar y hacer una maratón de Stanley Kubrik. Para los que prefieran otro tipo de entretenimiento, el animé de Fullmetal Alchemist está en Netflix en sus dos versiones (aunque todos sabemos que la que hay que mirar es Fullmetal Alchemist Brotherhood).

P.D.: Para todos los que sigan pensando en cómo la flecha del tiempo emerge en sistemas físicos y su relación con la entropía, les dejo el link a este excelente paper que salió publicado ayer en Physical Review X del grupo de investigación en Inglaterra de una graduada del DF, Natalia Ares. El trabajo mide en el laboratorio el costo termodinámico de medir el tiempo, y muestra que cuanto más se intenta mejorar la precisión de un reloj, más aumento de la entropía produce la medición del tiempo. Así, el trabajo vincula lo que mide un reloj (el tiempo) con el aumento de la entropía.

Eterno retorno de una configuración sin recuerdos

“Ha llegado el momento de anunciar: Esta isla, con sus edificios, es nuestro paraíso privado. He tomado algunas precauciones -físicas, morales- para su defensa: creo que lo protegerán. Aquí estaremos eternamente -aunque mañana nos vayamos- repitiendo consecutivamente los momentos de la semana y sin poder salir nunca de la conciencia que tuvimos en cada uno de ellos.“

Adolfo Bioy Casares, La invención de Morel (1940).

El título del posteo de hoy hace referencia a Eterno resplandor de una mente sin recuerdos, película de 2004 dirigida por Michel Gondry en base a un guión de Charlie Kaufman. Los interesados en las repeticiones pueden ver también I’m Thinking of Ending Things en Netflix (dirigida por Charlie Kaufman), y Memento o Tenet (estas dos últimas dirigidas por Christopher Nolan). También pueden leer “La invención de Morel” de Adolfo Bioy Casares. Pero sepan que la repetición eterna, como los espejos y la cópula para un heresiarca de Uqbar, es abominable (excepto tal vez para Friedrich Nietzsche). Probablemente nos parezca antinatural justamente porque nunca observamos en la naturaleza que las configuraciones de sistemas extensos se repitan exactamente de la misma forma. Esta observación fue una de críticas que Poincaré y Zermelo, entre otros, realizaron a la teoría estadística de Boltzmann. Imagino que Sísifo también tendría sus objeciones. Y a Dormammu tampoco le deben gustar las repeticiones:

En el teorema H de Boltzmann, su entropía casi siempre crece. Imaginemos un gas que ocupa la mitad de un recinto, separado en dos por un tabique. En un dado instante el tabique se retira, y el gas se expande hasta ocupar todo el recinto (con el consecuente aumento de la entropía). Dado que todas las configuraciones son equiprobables, en algún instante todas las moleculas del gas podrían estar en la primera mitad del recinto (al fin y al cabo, podemos tener configuraciones aún más extrañas que incluyan a un cerebro de Boltzmann, ¿no?). Pero si en ese preciso instante volvemos a poner el tabique, recuperamos en forma espontánea la primera configuración, que tenía menor entropía. Este posible retorno a una configuración previa fue visto por Poincaré como un problema abominable para la teoría de Boltzmann (aunque más tarde Poincaré se convenció de su valor y se retractó).

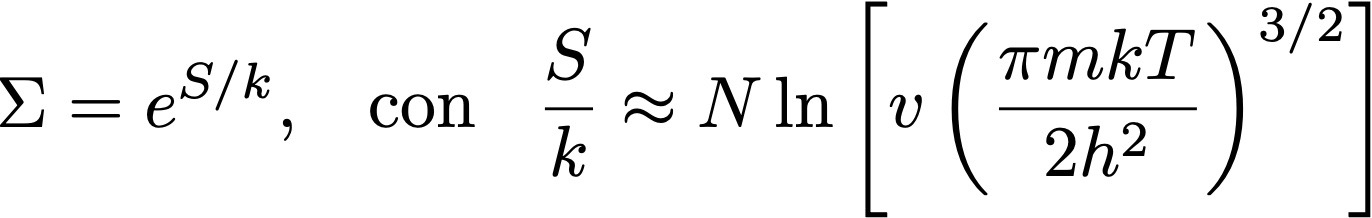

Efectivamente, si el número de configuraciones de un gas es discreto, existe una probabilidad no nula de que vuelva espontáneamente a una configuración previa (y si las configuraciones son contínuas, de que vuelva a una configuración arbitrariamente cercana a la configuración inicial). Pero el tiempo necesario para volver a encontrar esta configuración es increíblemente largo, lo que vuelve a este escenario irrelevante a fines prácticos. Estimemos esto para un metro cúbico de aire a temperatura ambiente (T = 300 K). Vimos que el número de configuraciones Σ de un gas ideal lo podemos calcular (en el ensamble microcanónico) como

donde S es la entropía, N el número de partículas, v el volúmen específico del gas, m la masa de las partículas (moléculas de N2), k la constante de Boltzmann, y h la constante de Planck (ignoro un factor aditivo despreciable en la entropía). Usando valores típicos para estos parámetros (y considerando que v ≈ 5 x 10-29 m3), obtenemos que el número de microestados o configuraciones posibles es

¡Este es un número enorme, con más de 1025 dígitos! Asumamos ahora que las configuraciones cambian cada vez que hay un choque entre partículas. Es decir, cuando las partículas en el gas chocan, intercambian momento, y pasan de una configuración a otra. Para el aire a temperatura y presión ambiente, el tiempo entre choques es τ ≈ 10-10 s. Y si todas las configuraciones son equiprobables, podemos estimar el tiempo medio para repetir una configuración como proporcional a Σ·τ, que sigue siendo un número muy grande (un tiempo con más de 1025 dígitos, medido en segundos). ¡Como comparación, la edad del universo es de 4.3 x 1017 s, muchísimo más chico que el tiempo medio necesario para repetir la configuración de un gas en solo un metro cúbico! Por lo que el “casi siempre crece” de Boltzmann está bastante bien.

Como adelanté en un posteo previo, hoy sabemos que aún en sistemas con tamaño finito fuera del equilibro, la probabilidad de que la entropía crezca es mucho más grande que la probabilidad de que la entropía disminuya. De hecho, sabemos que la razón entre estas dos probabilidades es igual a la exponencial de la variación de la entropía por el tiempo transcurrido, un número que se vuelve exponencialmente más grande a medida que la entropía del sistema crece, o que transcurre más tiempo. En el caso general, este resultado se conoce como el teorema de fluctuación detallado.

Además de las películas que ya mencioné y de Dr. Strange, muchas otras películas exploran la idea abominable de la eterna repetición (aunque no todas la consideran abominable). En particular, les recomiendo las siguientes para mirar durante la pandemia: El día de la marmota (1993), Corre Lola corre (1996), La llegada (2016), y La chica que saltaba en el tiempo (2006, para los amantes del animé, está en Netflix). Y si quieren leer otro ejemplo de objeciones que se plantearon a la teoría cinética y a los cambios en la física entre fines del siglo XIX y principios del siglo XX, pueden mirar este artículo.

Stanislaw Lem y sus demonios

Stanislaw Lem fue un escritor polaco, autor de Solaris. El libro fue la base para el guión de la película Solaris (1972) dirigida por Andrei Tarkovsky (no estoy hablando de la remake de Hollywood). En Solaris, Lem imagina el oceano de un planeta que desarrolla en forma espontánea su propia conciencia (con un claro vínculo con los cerebros de Boltzmann del post previo). Pero las novelas y cuentos de Stanislaw Lem tienen otros vínculos interesantes con la termodinámica y la mecánica estadística.

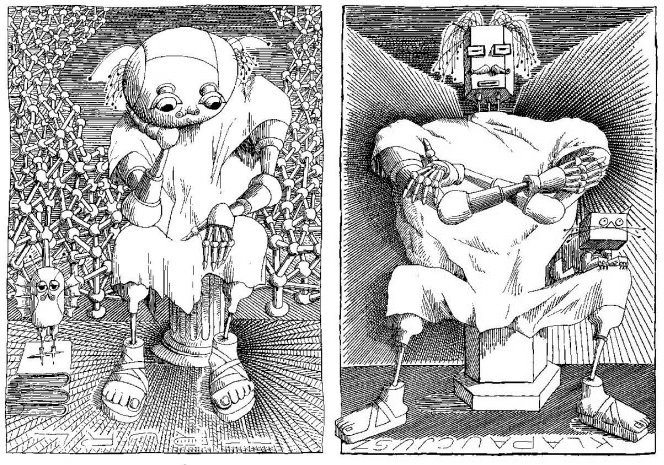

En Ciberíada, Lem escribe cuentos breves sobre las aventuras de dos constructores, Trurl y Clapaucio. Ambos tienen poderes y capacidad de construcción sobrehumanos, y fueron ilustrados, en la edición original de Ciberíada, por Daniel Mróz, un artista polaco responsable de la ilustración de otros libros y novelas de Lem.

En una de las historias de Ciberíada, ambos son capturados por un pirata con un doctorado sediento de información. Para escapar, Trurl y Clapaucio construyen un demonio del segundo tipo (un demonio del primer tipo, para Lem, es un demonio de Maxwell, considerado una trivialidad por Trurl y Clapaucio). El demonio de Lem puede observar todas las moléculas de un gas en cada microestado posible, y extraer información de sus configuraciones. ¿Al fin y al cabo, siendo todos los microestados posibles, algunos microestados pueden corresponder a ordenamientos de las moléculas que revelen leyes fundamentales o secretos insondables del universo, no? Esto es nada más y nada menos que le versión gaseosa de La Biblioteca de Babel de Borges.

“Si primero jura solemnemente, de arriba abajo y cruzando su corazón, que nos dejará ir, le daremos información, información sobre información infinita, es decir, le haremos su propio Demonio de Segundo Tipo, que es mágico y termodinámico, no-clásico y estocástico, y de cualquier viejo barril o estornudo extraerá información para usted sobre todo lo que fue, es, puede ser o será. ¡Y no hay demonio más allá de este Demonio, porque es del Segundo Tipo, y si lo quiere, dígalo ahora!“

Stanislaw Lem, Ciberíada (1965)

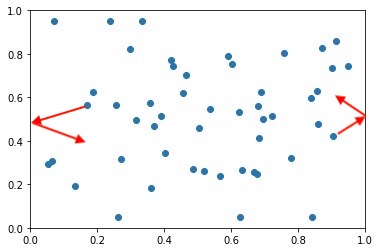

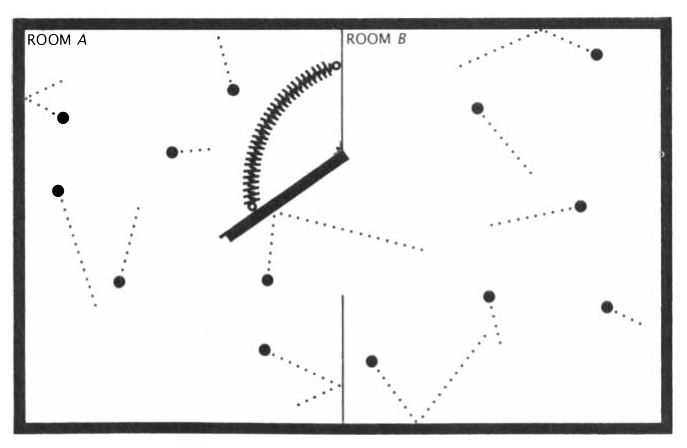

Pero, ¿qué es un demonio de Maxwell, o el despreciado demonio del primer tipo de Lem? Imaginemos un gas en un recinto, separado por un tabique. En el tabique agregamos una compuerta con un resorte, como se muestra en la siguiente figura:

En 1867, James Clerk Maxwell imaginó un demonio que podía conocer el estado de cada una de las partículas en este gas. Este demonio es puesto a controlar la compuerta de la figura. Cada vez que una molécula del lado B se acerca a la compuerta, el demonio observa su energía cinética. Si es grande, el demonio cierra la compuerta. Pero si su energía cinética es pequeña, el demonio abre la compuerta y deja pasar la molécula al recinto A. De esta forma, el demonio puede bajar la temperatura y disminuir la entropía del gas en el recinto A, violando (aparentemente) la segunda ley de la termodinámica.

La solución a esta paradoja está relacionada con que el proceso de medir, almacenar, y borrar información del estado de cada molécula requiere realizar trabajo. Los primeros argumentos contra el demonio de Maxwell, de Szilárd Y Brillouin en 1929, consideraban simplemente el trabajo asociado a medir la velocidad de cada molécula, y su costo energético. En este caso, considerando el sistema completo (el gas en ambos recintos y el demonio de Maxwell), la entropía crece y el segundo principio está salvado. Con el tiempo las restricciones en el mínimo de energía necesario para medir el estado de la molécula fueron bajando, y argumentos más modernos contra el demonio de Maxwell usan teoría de la información para estimar el mínimo costo energético necesario para procesar la información adquirida por el demonio. La buena noticia es que aún con las cotas más modernas, el segundo principio no puede ser violado por el demonio de Maxwell, sin importar cuán omnisciente sea (y probablemente Trurl y Clapaucio tampoco puedan violarlo). Los que quieran aprender más sobre este tema pueden leer este excelente artículo, encontrado en cuatrimestres previos por Guillem Pérez Nadal: