El modelo de Ising es un modelo de juguete para el ferromagnetismo. Sin embargo, esto no significa que sea un modelo poco importante, o que solo tenga utilidad pedagógica. En cierto sentido, el modelo de Ising es el Buzz Lightyear de los modelos de juguete. El modelo, en su forma más sencilla y en dos dimensiones, consiste en un arreglo de espines (o dipolos magnéticos) que solo pueden tomar dos valores (+1 o -1). En ausencia de un campo magnético externo, los dipolos interactúan entre sí tratando de alinearse con sus vecinos más cercanos. A bajas temperaturas este arreglo de espines tiende a generar islas con la misma orientación, y si tenemos más espines con un signo que con el otro, entonces el material estará magnetizado. La transición entre el material no magnetizado y el material magnetizado, al bajar la temperatura, es una transición de fase similar (aunque no del mismo orden) a los cambios en los estados de agregación de la materia.

El desarrollo de la mecánica estadística entre fines del siglo XIX y principios del siglo XX, de la mano de Boltzmann y de Gibbs, permitió a los físicos comprender mejor varios sistemas y procesos (como el gas ideal, o los fenómenos de transporte), formalizar conceptos (como la noción de equilibrio, los microestados, el desorden, y la entropía), y estudiar fenómenos nuevos (como el condensado de Bose-Eistein, o la superfluidez y la superconductividad). Además, la mecánica estadística amplió el campo de aplicación de la física a otras áreas y a temas interdisciplinarios.

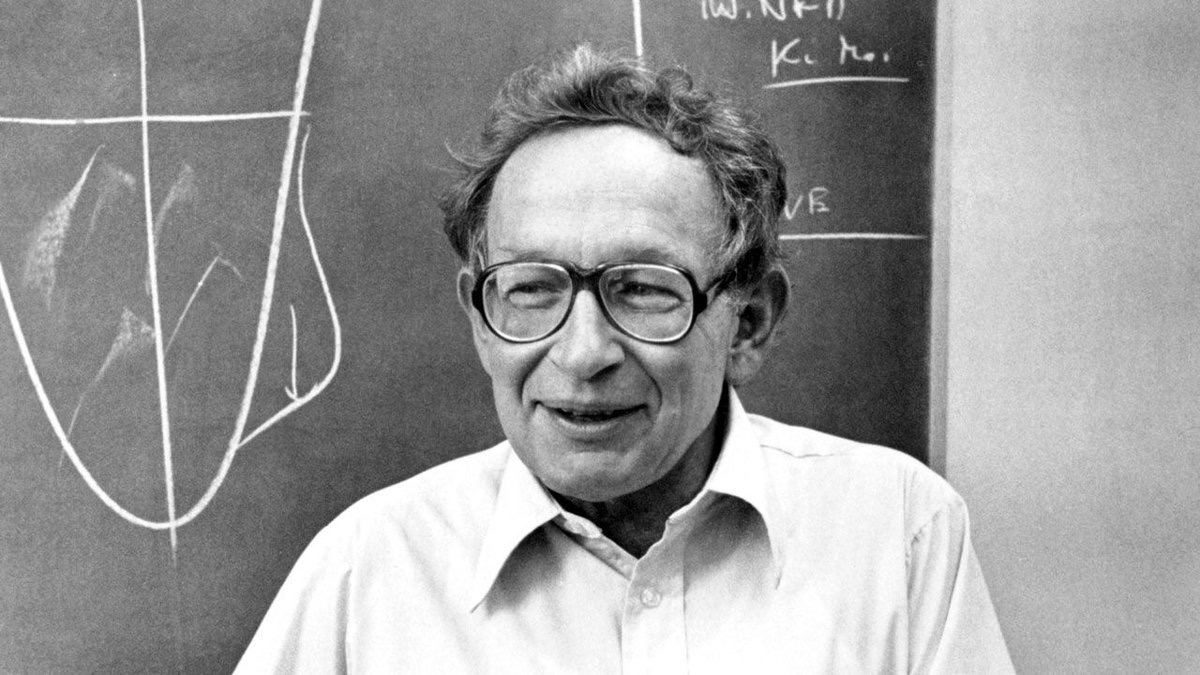

Sin embargo, aún en 1944 (más de 70 años después de la publicación de la ecuación de Boltzmann) no estaba claro si la mecánica estadística podría capturar y ayudar a comprender las transiciones de fase, como ocurren en la transición de agua líquida a vapor de agua, o en la magnetización espontánea de ciertos materiales (reales, no de juguete) al bajar su temperatura. Y aquí es donde el modelo de Ising, y Lars Onsager, abrieron las puertas a muchos desarrollos cruciales para la física en la segunda mitad del siglo XX. En 1944 Onsager encontró una solución exacta al modelo de Ising en dos dimensiones, calculando la función de partición del sistema, mostrando que podía sufrir una transición de fase y magnetizarse espontáneamente, y calculando la temperatura a la que ocurre la transición. La solución mostró por primera vez que las transiciones de fase aparecen como singularidades de las funciones termodinámicas del sistema, y convenció a los físicos de que la mecánica estadística podía ser usada para estudiar estos fenómenos. Fue tan relevante que al terminar la segunda guerra mundial, cuando varios físicos volvieron a la investigación básica, Hendrik Casimir le comentó en una carta a Wolfgang Pauli que estaba preocupado y dudaba de si podría volver a trabajar en física teórica luego de haber perdido contacto con el tema por tanto tiempo. Pauli (que era famoso por evaluar las teorías de sus colegas muy duramente) lo tranquilizó respondiendo que durante la guerra solo hubo un resultado que debía mirar: “No ha ocurrido mucho que sea de interés, excepto por la solución exacta de Onsager al modelo de Ising en dos dimensiones“.

Onsager es un personaje interesante. Muchos de sus resultados no fueron publicados en papers. La solución exacta al modelo de Ising apreció como una discusión de otro paper, su formula para la temperatura de la transición quedó en un pizarrón luego de un seminario que dió László Tisza, y la predicción de la cuantización de vórtices en un superfluido (luego redescubierta por Feynman) apareció en un paper resumiendo un seminario de otro investigador, en la sección de preguntas y respuestas del público.

Los que quieran jugar un poco con el modelo de Ising en 2D (antes de la práctica numérica), pueden mirar la siguiente página donde pueden simular el sistema con el método de Montecarlo, y variar la temperatura y el campo magnético externo. Para un campo externo igual a cero, prueben ver que pasa con la amplitud de las fluctuaciones en la magnetización si se acercan a la temperatura crítica (Tc ≈ 2.27) desde arriba (es decir, desde temperaturas altas):

Para terminar, no se pierdan el video en el que Onsager le explica a Ising que solo es un juguete: